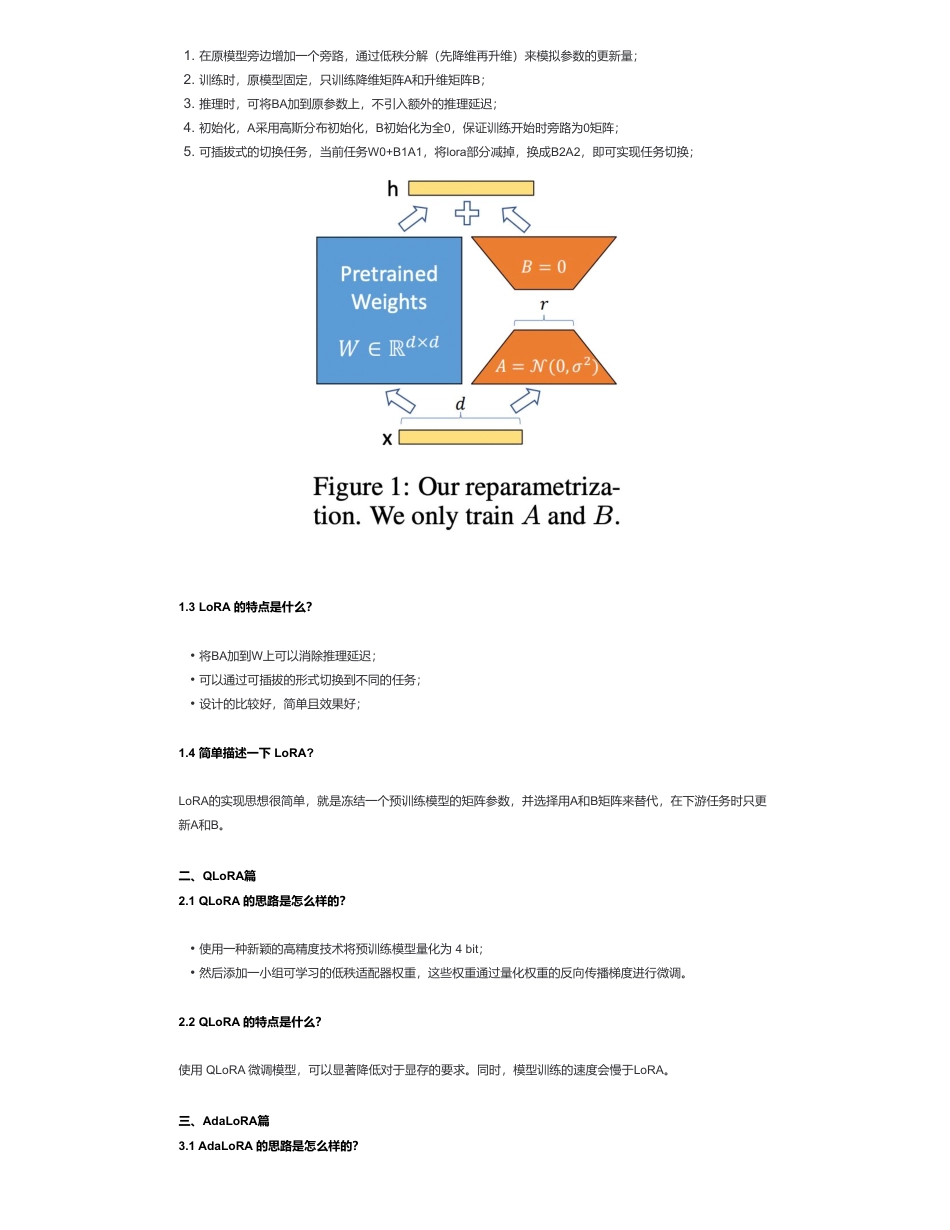

LoRA系列篇来自:AiGC面试宝典宁静致远2023年09月28日23:17一、LoRA篇1.1什么是LoRA?1.2LoRA的思路是什么?•LoRA系列篇•一、LoRA篇•1.1什么是LoRA?•1.2LoRA的思路是什么?•1.3LoRA的特点是什么?•1.4简单描述一下LoRA?•二、QLoRA篇•2.1QLoRA的思路是怎么样的?•2.2QLoRA的特点是什么?•三、AdaLoRA篇•3.1AdaLoRA的思路是怎么样的?•四、LoRA权重是否可以合入原模型?•五、ChatGLM-6BLoRA后的权重多大?•六、LoRA微调优点是什么?•七、LoRA微调方法为啥能加速训练?•八、如何在已有LoRA模型上继续训练?•九、LoRA缺点是什么?•十、LoRA这种微调方法和全参数比起来有什么劣势吗?•十一、LORA应该作用于Transformer的哪个参数矩阵?•十二、LoRA微调参数量怎么确定?•十三、Rank如何选取?•十四、alpha参数如何选取?•十五、LoRA高效微调如何避免过拟合?•十六、微调大模型时,优化器如何?•十七、哪些因素会影响内存使用?•十八、LoRA权重是否可以合并?•十九、是否可以逐层调整LoRA的最优rank?•二十、Lora的矩阵怎么初始化?为什么要初始化为全0?•实践篇•1.LoRA微调计算可训练参数的比例如何确定?•2.LoRA微调结果如何保存?•介绍:通过低秩分解来模拟参数的改变量,从而以极小的参数量来实现大模型的间接训练。扫码加查看更多1.3LoRA的特点是什么?1.4简单描述一下LoRA?LoRA的实现思想很简单,就是冻结一个预训练模型的矩阵参数,并选择用A和B矩阵来替代,在下游任务时只更新A和B。二、QLoRA篇2.1QLoRA的思路是怎么样的?2.2QLoRA的特点是什么?使用QLoRA微调模型,可以显著降低对于显存的要求。同时,模型训练的速度会慢于LoRA。三、AdaLoRA篇3.1AdaLoRA的思路是怎么样的?1.在原模型旁边增加一个旁路,通过低秩分解(先降维再升维)来模拟参数的更新量;2.训练时,原模型固定,只训练降维矩阵A和升维矩阵B;3.推理时,可将BA加到原参数上,不引入额外的推理延迟;4.初始化,A采用高斯分布初始化,B初始化为全0,保证训练开始时旁路为0矩阵;5.可插拔式的切换任务,当前任务W0+B1A1,将lora部分减掉,换成B2A2,即可实现任务切换;•将BA加到W上可以消除推理延迟;•可以通过可插拔的形式切换到不同的任务;•设计的比较好,简单且效果好;•使用一种新颖的高精度技术将预训练模型量化为4bit;•然后添加一小组可学习的低秩适配器权重,这些权重通过量化权重的反向传播梯度进行微调。对LoRA的一种改进,它根据重要性评分动态分配参数预算给权重矩阵,将关键的增量矩阵分配高秩以捕捉更精细和任务特定的信息,而将较不重要的矩阵的秩降低,以防止过拟合并节省计算预算。四、LoRA权重是否可以合入原模型?可以,将训练好的低秩矩阵(B*A)+原模型权重合并(相加),计算出新的权重。五、ChatGLM-6BLoRA后的权重多大?rank8target_modulequery_key_value条件下,大约15M。六、LoRA微调优点是什么?七、LoRA微调方法为啥能加速训练?这三部分原因确实能加快训练速度,然而它们并不是LoRA所独有的,事实上几乎都有参数高效方法都具有这些特点。LoRA的优点是它的低秩分解很直观,在不少场景下跟全量微调的效果一致,以及在预测阶段不增加推理成本。八、如何在已有LoRA模型上继续训练?理解此问题的情形是:已有的lora模型只训练了一部分数据,要训练另一部分数据的话,是在这个lora上继续训练呢,还是跟base模型合并后再套一层lora,或者从头开始训练一个lora?我认为把之前的LoRA跟basemodel合并后,继续训练就可以,为了保留之前的知识和能力,训练新的LoRA时,加入一些之前的训练数据是需要的。另外,每次都重头来成本高。九、LoRA缺点是什么?缺点很明显,参与训练的模型参数量不多,也就百万到千万级别的参数量,所以效果比全量微调差很多。可能在扩散模型上感知没那么强,但在LLM上,个人感觉表现还是差距挺大的。十、LoRA这种微调方法和全参数比起来有什么劣势吗?如果有足够计算资源以及有10k以上数据,我还是建议全参数微调,lora的一个初衷就是为了解决不够计算资源的情况下微调,只引入了少量参数,就可以在消费级gpu上训练,但lora的问题...

发表评论取消回复